Οι φωνητικές απάτες με τεχνητή νοημοσύνη γίνονται πιο διαδεδομένες και μπορεί να είναι εξαιρετικά πειστικές επειδή ακούγεται σαν να μιλάτε με ένα αγαπημένο σας πρόσωπο. Τώρα έχουμε μια εις βάθος αναφορά που εξετάζει τον τρόπο με τον οποίο λειτουργεί η κλωνοποίηση φωνής με τεχνητή νοημοσύνη, πόσο συχνές είναι οι απάτες, την πιθανότητα να πέσουμε σε μια, το μέσο κόστος, καθώς και τον τρόπο πρόληψης και προστασίας από φωνητικές απάτες AI.

Τον Απρίλιο, είδαμε μερικά πραγματικά παραδείγματα απατών τεχνητής νοημοσύνης επόμενης γενιάς που είναι αρκετά τρομακτικά. Ένας από αυτούς χρησιμοποίησε πλαστογράφηση κλήσεων, έτσι ένα αγαπημένο πρόσωπο εμφανίστηκε στο τηλέφωνο του θύματος ως το άτομο που καλούσε. Ένας άλλος χρησιμοποίησε έναν κλώνο φωνής AI για να προσπαθήσει να εκβιάσει μια μητέρα ζητώντας χρήματα για να απελευθερώσει την κόρη της – που δεν απήχθη.

Πώς λειτουργεί η κλωνοποίηση φωνής AI;

Η McAfee τονίζει ότι οι φωνητικές απάτες με τεχνητή νοημοσύνη είναι ένα remix των «απατών από απατεώνες» που υπάρχουν εδώ και πολύ καιρό, αλλά μπορεί να είναι πολύ πιο πειστικές. Συχνά περιλαμβάνει τον απατεώνα να χρησιμοποιεί τη φωνή ενός αγαπημένου προσώπου και να ζητά χρήματα για έκτακτη ανάγκη ή σε ορισμένες περιπτώσεις να προσποιείται ότι κρατά ένα αγαπημένο πρόσωπο για λύτρα.

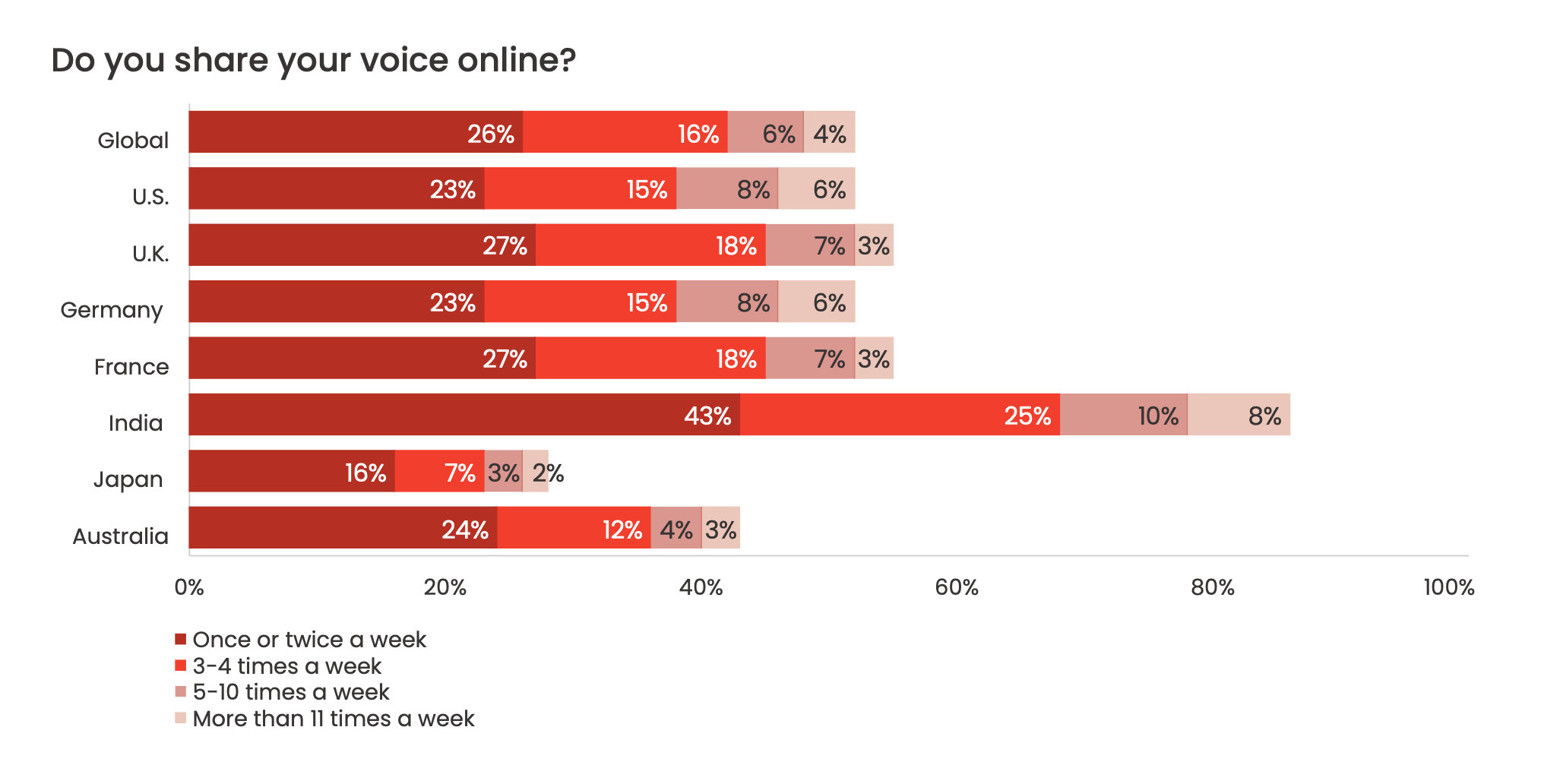

Επειδή τα εργαλεία κλωνοποίησης φωνής AI είναι τόσο φθηνά και διαθέσιμα, είναι γρήγορο και εύκολο για τα κακόβουλα μέρη να δημιουργήσουν κλώνους φωνής. Και ο τρόπος με τον οποίο λαμβάνουν δείγμα ήχου για να το κάνουν αυτό είναι από άτομα που μοιράζονται τις φωνές τους στα μέσα κοινωνικής δικτύωσης. Και όσο περισσότερο μοιράζεστε τη φωνή σας στο διαδίκτυο, τόσο πιο εύκολο είναι για τους συντελεστές απειλών να βρουν και να κλωνοποιήσουν τη φωνή σας.

Πόσο συχνές είναι οι φωνητικές απάτες AI;

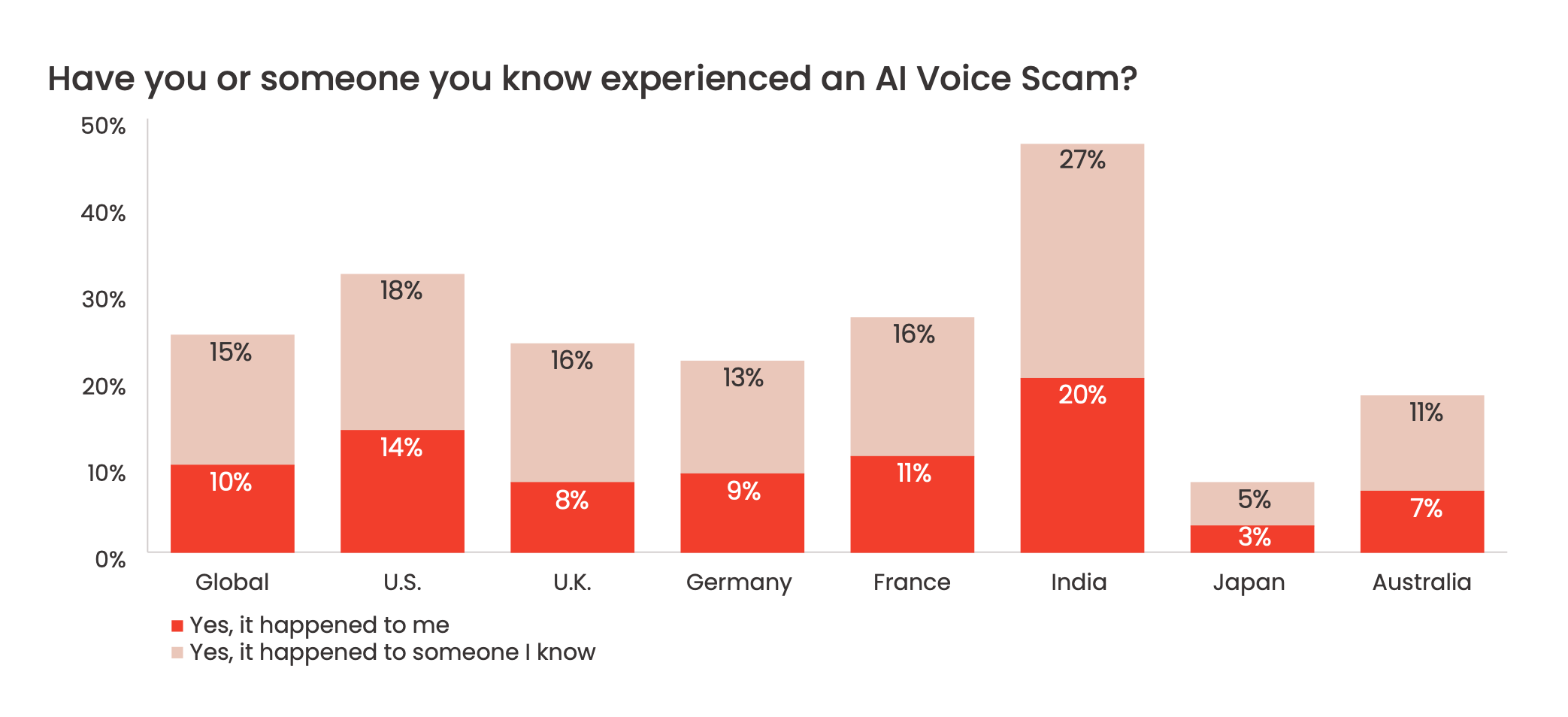

Ενώ μόλις αρχίσαμε να βλέπουμε μερικές πραγματικές ιστορίες στις ειδήσεις σχετικά με φωνητικές απάτες με τεχνητή νοημοσύνη, η μελέτη της McAfee διαπίστωσε ότι γίνονται αρκετά κοινές.

Ο παγκόσμιος μέσος όρος έδειξε ότι το 25% των ατόμων που συμμετείχαν στην έρευνα είτε βίωσαν μια απάτη με τεχνητή νοημοσύνη είτε κάποιος που γνωρίζουν.

Αυτό ήταν υψηλότερο στις ΗΠΑ στο 32% με την Ινδία να αντιμετωπίζει τα περισσότερα προβλήματα με τις φωνητικές απάτες με τεχνητή νοημοσύνη στο 47% των ερωτηθέντων που δηλώνουν ότι αυτοί ή κάποιος που γνωρίζουν έχει επηρεαστεί.

Πόσο ακρίβεια έχουν;

Στις δημοσίως αναφερόμενες περιπτώσεις απατών κλωνοποίησης φωνής με τεχνητή νοημοσύνη, τα θύματα εξιστορούν πώς η φωνή ακουγόταν «ακριβώς όπως» το άτομο που κλωνοποιήθηκε. Σε μια ιδιαίτερα κραυγαλέα περίπτωση, όπου ένας εγκληματίας του κυβερνοχώρου ζήτησε λύτρα για μια ψεύτικη απαγωγή, η μητέρα είπε ότι ήταν «απολύτως η φωνή της» και ότι «ήταν η κλίση της». Τώρα είναι πιο δύσκολο από ποτέ να ξεχωρίσεις το πραγματικό από το ψεύτικο, επομένως οι άνθρωποι θα πρέπει να υποθέσουν ότι δεν μπορούν πάντα να πιστέψουν αυτό που βλέπουν και ακούν.

Πώς να αποτρέψετε και να προστατευτείτε από απάτες AI

- Περιορίστε πόσο μοιράζεστε τη φωνή και/ή το βίντεό σας στο διαδίκτυο ή/και ορίστε τους λογαριασμούς σας στα μέσα κοινωνικής δικτύωσης σε ιδιωτικούς αντί για δημόσιους

- Κάντε μια ερώτηση πρόκλησης ή ακόμα και δύο εάν λάβετε μια ύποπτη κλήση – κάτι που μόνο το αγαπημένο σας πρόσωπο θα μπορούσε να απαντήσει (π.χ. ονομάστε το λούτρινο ζωάκι της παιδικής σας ηλικίας κ.λπ.)

- Θυμηθείτε, μην κάνετε μια ερώτηση στην οποία θα μπορούσε να βρεθεί η απάντηση στα μέσα κοινωνικής δικτύωσης, στο διαδίκτυο κ.λπ.

- Αφήστε άγνωστους αριθμούς να πάνε στον αυτόματο τηλεφωνητή και καλέστε ή στείλτε μήνυμα με το άτομο απευθείας από το τηλέφωνό σας, εάν ανησυχείτε για αυτούς

Επίσης:

1. Ορίστε μια «κωδική λέξη» με παιδιά, μέλη της οικογένειας ή έμπιστους στενούς φίλους που μόνο αυτά θα μπορούσαν να γνωρίζουν. Κάντε ένα σχέδιο να το ζητάτε πάντα εάν τηλεφωνούν, στέλνουν μήνυμα ή email για να ζητήσουν βοήθεια, ιδιαίτερα εάν είναι μεγαλύτεροι ή πιο ευάλωτοι.

2. Να αμφισβητείτε πάντα την πηγή—Εάν πρόκειται για κλήση, μήνυμα κειμένου ή email από άγνωστο αποστολέα ή ακόμα και αν προέρχεται από έναν αριθμό που αναγνωρίζετε, σταματήστε και σκεφτείτε. Η υποβολή κατευθυνόμενων ερωτήσεων μπορεί να απορρίψει έναν απατεώνα. Για παράδειγμα, “Μπορείτε να επιβεβαιώσετε το όνομα του γιου μου;” ή, “Πότε είναι τα γενέθλια του πατέρα σου;” Αυτό όχι μόνο μπορεί να αιφνιδιάσει τον απατεώνα, αλλά μπορεί επίσης να χρειαστεί να δημιουργήσει μια νέα απάντηση, η οποία μπορεί να προσθέσει αφύσικες παύσεις στη συζήτηση και να δημιουργήσει υποψίες.

3. Μην αφήνετε τα συναισθήματά σας να κυριαρχούν. Οι εγκληματίες του κυβερνοχώρου βασίζονται στη συναισθηματική σας σχέση με το άτομο που υποδύονται για να σας ωθήσουν στη δράση. Κάντε ένα βήμα πίσω πριν απαντήσετε. Ακούγεται πραγματικά σαν αυτούς; Είναι κάτι που θα σας ζητούσαν; Κλείστε το τηλέφωνο και καλέστε απευθείας το άτομο ή προσπαθήστε να επαληθεύσετε τις πληροφορίες πριν απαντήσετε.

4. Σκεφτείτε εάν θα απαντήσετε σε μη αναμενόμενες κλήσεις από άγνωστους αριθμούς τηλεφώνου. Είναι γενικά καλή συμβουλή να μην απαντάτε σε κλήσεις αγνώστων. Εάν αφήσουν ένα τηλεφωνητή, αυτό σας δίνει χρόνο να σκεφτείτε και να επικοινωνήσετε ανεξάρτητα με τα αγαπημένα σας πρόσωπα για να επιβεβαιώσετε την ασφάλειά τους.

| Ακολουθήστε το AppleWorldHellas στο Google News για να ενημερώνεστε άμεσα για όλα τα νέα άρθρα! Όσοι χρησιμοποιείτε υπηρεσία RSS (π.χ. Feedly), μπορείτε να προσθέσετε το AppleWorldHellas στη λίστα σας με αντιγραφή και επικόλληση της διεύθυνσης https://appleworldhellas.com/feed. Ακολουθήστε επίσης το AppleWorldHellas.com σε Facebook, Twitter, Instagram, και YouTube |