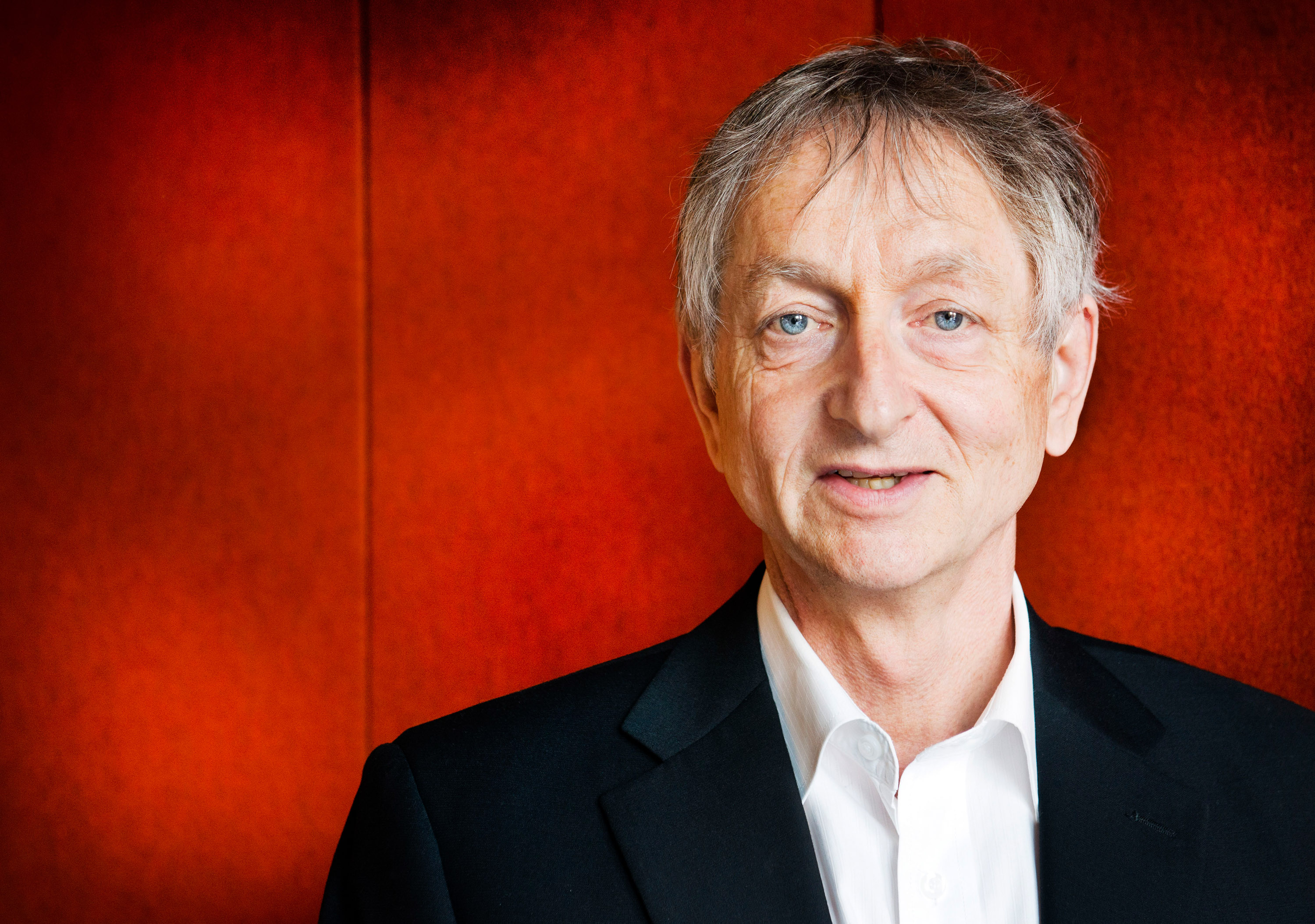

Για μισό αιώνα, ο Geoffrey Hinton έθρεψε την τεχνολογία στην καρδιά των chatbots όπως το ChatGPT. Τώρα ανησυχεί ότι θα προκαλέσει σοβαρή βλάβη.

Ο Geoffrey Hinton ήταν πρωτοπόρος της τεχνητής νοημοσύνης. Το 2012, ο Hinton και δύο από τους μεταπτυχιακούς φοιτητές του στο Πανεπιστήμιο του Τορόντο δημιούργησαν τεχνολογία που έγινε το πνευματικό θεμέλιο για τα A.I. συστήματα που οι μεγαλύτερες εταιρείες της βιομηχανίας τεχνολογίας πιστεύουν ότι είναι το κλειδί για το μέλλον τους.

Τη Δευτέρα, ωστόσο, εντάχθηκε επίσημα σε μια αυξανόμενη μερίδα κριτικών που λένε ότι αυτές οι εταιρείες τρέχουν προς τον κίνδυνο με την επιθετική τους καμπάνια για τη δημιουργία προϊόντων που βασίζονται στη γενετική τεχνητή νοημοσύνη, την τεχνολογία που τροφοδοτεί δημοφιλή chatbots όπως το ChatGPT.

Ο Hinton είπε ότι έχει παραιτηθεί από τη δουλειά του στη Google, όπου εργάζεται για περισσότερο από μια δεκαετία και έχει γίνει μια από τις πιο σεβαστές φωνές στον τομέα, ώστε να μπορεί να μιλήσει ελεύθερα για τους κινδύνους της A.I. Ένα μέρος του, είπε, μετανιώνει τώρα για το έργο της ζωής του.

«Παρηγορώ τον εαυτό μου με την δικαιολογία: αν δεν το είχα κάνει εγώ, κάποιος άλλος θα το έκανε», είπε ο Hinton κατά τη διάρκεια μιας εκτενούς συνέντευξης την περασμένη εβδομάδα στην τραπεζαρία του σπιτιού του στο Τορόντο, σε μικρή απόσταση με τα πόδια από όπου και οι μαθητές του έκαναν το επίτευγμά τους.

Το ταξίδι του Hinton από το A.I. που μπήκε στην καθημερινότητα μας μέχρι το δυσοίωνο μέλλον που προβλέπει σηματοδοτεί μια αξιοσημείωτη στιγμή για τον κλάδο της τεχνολογίας στο σημαντικότερο ίσως σημείο καμπής της εδώ και δεκαετίες. Οι ηγέτες του κλάδου πιστεύουν ότι η νέα A.I. και τα αντίστοιχα συστήματα θα μπορούσαν να είναι εξίσου σημαντικά με την εισαγωγή του προγράμματος περιήγησης Ιστού στις αρχές της δεκαετίας του 1990 και θα μπορούσαν να οδηγήσουν σε ανακαλύψεις σε τομείς που κυμαίνονται από την έρευνα για τα φάρμακα έως την εκπαίδευση.

Αλλά πολλοί γνώστες της βιομηχανίας αυτής εκφράζουν έναν φόβο ότι απελευθερώνουν κάτι επικίνδυνο στη φύση. Το Generative A.I. μπορεί ήδη να αποτελέσει εργαλείο παραπληροφόρησης. Σύντομα, θα μπορούσε να αποτελέσει κίνδυνο για τις θέσεις εργασίας. Κάποια στιγμή μάλιστα, λένε οι μεγαλύτεροι ανησυχούντες της τεχνολογίας, θα μπορούσε να είναι κίνδυνος ακόμη και για την ανθρωπότητα.

«Είναι δύσκολο να δεις πώς μπορείς να αποτρέψεις τους κακούς ανθρώπους από το να το χρησιμοποιήσουν για κακά πράγματα», είπε ο Hinton.

Αφού η start-up OpenAI από το Σαν Φρανσίσκο κυκλοφόρησε μια νέα έκδοση του ChatGPT τον Μάρτιο, περισσότεροι από 1.000 ηγέτες τεχνολογίας και ερευνητές υπέγραψαν μια ανοιχτή επιστολή ζητώντας ένα εξάμηνο μορατόριουμ για την ανάπτυξη νέων συστημάτων, επειδή οι τεχνολογίες A.I αποτελούν «κινδύνους για την κοινωνία και την ανθρωπιά.”

Αρκετές μέρες αργότερα, 19 νυν και πρώην ηγέτες της Ένωσης για την Προώθηση της Τεχνητής Νοημοσύνης, μιας ακαδημαϊκής εταιρείας 40 ετών, δημοσίευσαν τη δική τους επιστολή προειδοποιώντας για τους κινδύνους της A.I. Αυτή η ομάδα περιελάμβανε τον Eric Horvitz, επικεφαλής επιστημονικό υπεύθυνο της Microsoft, η οποία έχει αναπτύξει την τεχνολογία του OpenAI σε ένα ευρύ φάσμα προϊόντων, συμπεριλαμβανομένης της μηχανής αναζήτησης Bing.

Ο Hinton, που συχνά αποκαλείται «ο Νονός της A.I.», δεν υπέγραψε καμία από αυτές τις επιστολές και είπε ότι δεν ήθελε να επικρίνει δημόσια την Google ή άλλες εταιρείες μέχρι να παραιτηθεί από τη δουλειά του. Ενημέρωσε την εταιρεία τον περασμένο μήνα ότι παραιτήθηκε και την Πέμπτη, μίλησε τηλεφωνικά με τον Sundar Pichai, τον διευθύνοντα σύμβουλο της μητρικής εταιρείας της Google, Alphabet. Αρνήθηκε να συζητήσει δημόσια τις λεπτομέρειες της συνομιλίας του με τον κ. Pichai.

Ο επικεφαλής επιστήμονας της Google, Jeff Dean, δήλωσε σε μια δήλωση: «Παραμένουμε δεσμευμένοι σε μια υπεύθυνη προσέγγιση για την A.I. Μαθαίνουμε συνεχώς να κατανοούμε τους αναδυόμενους κινδύνους, ενώ παράλληλα καινοτομούμε με τόλμη».

Η Google ξόδεψε 44 εκατομμύρια δολάρια για να αποκτήσει μια εταιρεία που ξεκίνησε ο Hinton και οι δύο μαθητές του. Και το σύστημά τους οδήγησε στη δημιουργία ολοένα και πιο ισχυρών τεχνολογιών, συμπεριλαμβανομένων νέων chatbots όπως το ChatGPT και το Google Bard. Ο κ. Sutskever έγινε επικεφαλής επιστήμονας στο OpenAI. Το 2018, ο Hinton και δύο άλλοι μακροχρόνιοι συνεργάτες του έλαβαν το βραβείο Turing, το οποίο συχνά αποκαλείται «Βραβείο Νόμπελ υπολογιστών», για την εργασία τους στα νευρωνικά δίκτυα.

Την ίδια περίοδο, η Google, η OpenAI και άλλες εταιρείες άρχισαν να κατασκευάζουν νευρωνικά δίκτυα που διδάσκονταν από τεράστιες ποσότητες ψηφιακού κειμένου. Ο Hinton πίστευε ότι ήταν ένας ισχυρός τρόπος για τις μηχανές να κατανοούν και να δημιουργούν γλώσσα, αλλά ήταν κατώτερος από τον τρόπο που οι άνθρωποι χειρίζονταν τη γλώσσα.

Στη συνέχεια, πέρυσι, καθώς η Google και το OpenAI κατασκεύασαν συστήματα χρησιμοποιώντας πολύ μεγαλύτερες ποσότητες δεδομένων, η άποψή του άλλαξε. Εξακολουθούσε να πίστευε ότι τα συστήματα ήταν κατώτερα από τον ανθρώπινο εγκέφαλο κατά κάποιο τρόπο, αλλά πίστευε ότι επισκίαζαν την ανθρώπινη νοημοσύνη. «Ίσως αυτό που συμβαίνει σε αυτά τα συστήματα», είπε, «είναι στην πραγματικότητα πολύ καλύτερο από αυτό που συμβαίνει στον εγκέφαλο».

Καθώς οι εταιρείες βελτιώνουν το A.I τους. συστήματα, πιστεύει, γίνονται όλο και πιο επικίνδυνα. «Κοιτάξτε πώς ήταν πριν από πέντε χρόνια και πώς είναι τώρα», είπε για την A.I. τεχνολογία. «Πάρτε τη διαφορά και διαδώστε τη προς τα εμπρός. Αυτό είναι τρομακτικό.”

Μέχρι πέρυσι, είπε, η Google λειτουργούσε ως «σωστός διαχειριστής» για την τεχνολογία, προσέχοντας να μην κυκλοφορήσει κάτι που θα μπορούσε να προκαλέσει βλάβη. Αλλά τώρα που η Microsoft έχει αυξήσει τη μηχανή αναζήτησής της Bing με ένα chatbot – αμφισβητώντας τη βασική δραστηριότητα της Google – η Google αγωνίζεται να αναπτύξει το ίδιο είδος τεχνολογίας. Οι τεχνολογικοί γίγαντες είναι εγκλωβισμένοι σε έναν ανταγωνισμό που μπορεί να είναι αδύνατο να σταματήσει, είπε ο Hinton.

Η άμεση ανησυχία του είναι ότι το Διαδίκτυο θα πλημμυρίσει από ψευδείς φωτογραφίες, βίντεο και κείμενα και ο μέσος άνθρωπος «δεν θα μπορεί πλέον να γνωρίζει τι είναι αλήθεια».

Ανησυχεί επίσης ότι ο Α.Ι. οι τεχνολογίες θα ανατρέψουν με τον καιρό την αγορά εργασίας. Σήμερα, τα chatbots όπως το ChatGPT τείνουν να συμπληρώνουν τους ανθρώπινους εργαζομένους, αλλά θα μπορούσαν να αντικαταστήσουν τους δικηγόρους, τους προσωπικούς βοηθούς, τους μεταφραστές και άλλους που χειρίζονται επίμονες εργασίες. «Απομακρύνει την βαρετή δουλειά», είπε. «Μπορεί να αφαιρέσει περισσότερα από αυτό».

Στην πορεία, ανησυχεί ότι οι μελλοντικές εκδόσεις της τεχνολογίας αποτελούν απειλή για την ανθρωπότητα, επειδή συχνά μαθαίνουν απροσδόκητη συμπεριφορά από τις τεράστιες ποσότητες δεδομένων που αναλύουν. Αυτό γίνεται θέμα, είπε, καθώς ιδιώτες και εταιρείες επιτρέπουν στην A.I. συστήματα όχι μόνο για να δημιουργήσουν τον δικό τους κώδικα υπολογιστή, αλλά στην πραγματικότητα τον εκτελούν από μόνα τους διάφορα προγράμματα. Και φοβάται μια μέρα που τα πραγματικά αυτόνομα όπλα – αυτά τα ρομπότ δολοφόνων – θα γίνουν πραγματικότητα.

«Η ιδέα ότι αυτά τα πράγματα θα μπορούσαν στην πραγματικότητα να γίνουν πιο έξυπνα από τους ανθρώπους – μερικοί άνθρωποι το πίστευαν αυτό», είπε. «Αλλά οι περισσότεροι νόμιζαν ότι ήταν πολύ μακριά. Και νόμιζα ότι ήταν πολύ μακριά. Νόμιζα ότι ήταν 30 με 50 χρόνια ή και περισσότερο μακριά. Προφανώς, δεν το σκέφτομαι πια αυτό».

Πολλοί άλλοι ειδικοί, συμπεριλαμβανομένων πολλών μαθητών και συναδέλφων του, λένε ότι αυτή η απειλή είναι υποθετική. Αλλά ο Hinton πιστεύει ότι ο αγώνας μεταξύ Google και Microsoft και άλλων θα κλιμακωθεί σε έναν παγκόσμιο αγώνα που δεν θα σταματήσει χωρίς κάποιου είδους παγκόσμια ρύθμιση.

Αλλά αυτό μπορεί να είναι αδύνατο, είπε. Σε αντίθεση με τα πυρηνικά όπλα, είπε, δεν υπάρχει τρόπος να γνωρίζουμε εάν εταιρείες ή χώρες εργάζονται κρυφά στην τεχνολογία. Η καλύτερη ελπίδα είναι οι κορυφαίοι επιστήμονες του κόσμου να συνεργαστούν για τρόπους ελέγχου της τεχνολογίας. «Δεν νομίζω ότι πρέπει να το αυξήσουν περισσότερο μέχρι να καταλάβουν αν μπορούν να το ελέγξουν», είπε.

Ο Hinton είπε ότι όταν οι άνθρωποι τον ρωτούσαν πώς θα μπορούσε να εργαστεί σε τεχνολογία που ήταν δυνητικά επικίνδυνη, παρέφραζε τον Robert Oppenheimer, ο οποίος ηγήθηκε της προσπάθειας των ΗΠΑ για την κατασκευή της ατομικής βόμβας: «Όταν βλέπεις κάτι που είναι τεχνικά γλυκό, προχωρήστε και κάντε το.”

Δεν το λέει πια αυτό….

| Ακολουθήστε το AppleWorldHellas στο Google News για να ενημερώνεστε άμεσα για όλα τα νέα άρθρα! Όσοι χρησιμοποιείτε υπηρεσία RSS (π.χ. Feedly), μπορείτε να προσθέσετε το AppleWorldHellas στη λίστα σας με αντιγραφή και επικόλληση της διεύθυνσης https://appleworldhellas.com/feed. Ακολουθήστε επίσης το AppleWorldHellas.com σε Facebook, Twitter, Instagram, και YouTube |